目的:

在服务器上搭建Hadoop集群环境,包括服务器登录、JDK及Hadoop安装配置、SSH免密登录设置及Hadoop启动等关键步骤。

实验设备(环境)及要求

服务器,ubuntu系统

实验内容与步骤:

1. 登入云端服务器

要找到服务器的公网ip,然后用ssh登入就可以了。

2. 安装JDK

下载JDK1.8安装包。

wget https://download.java.net/openjdk/jdk8u41/ri/openjdk-8u41-b04-linux-x64-14_jan_2020.tar.gz

解压下载的JDK1.8安装包。

tar -zxvf openjdk-8u41-b04-linux-x64-14_jan_2020.tar.gz

移动并重命名JDK包。

mv java-se-8u41-ri/ /usr/java8

配置Java环境变量。

export PATH="/usr/local/sbin:/usr/local/bin:/usr/sbin:/usr/bin:/sbin:/bin:/usr/games:/usr/local/games:/snap/bin"

export JAVA_HOME=/usr/java8

export PATH=$JAVA_HOME/bin:$PATH

source /etc/profile

查看Java是否成功安装。

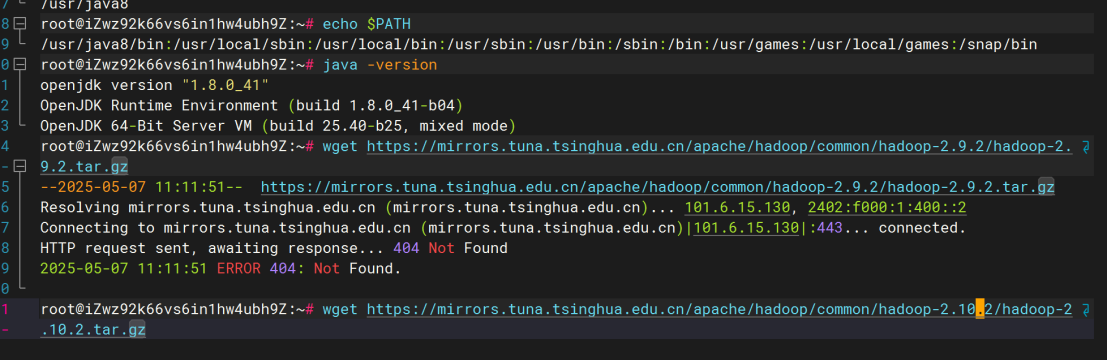

java -version

安装hadoop

下载Hadoop安装包

wget https://mirrors.tuna.tsinghua.edu.cn/apache/hadoop/common/hadoop-2.10.2/hadoop-2.10.2.tar.gz

解压Hadoop安装包至 /opt/hadoop

tar -zxvf hadoop-2.10.2.tar.gz -C /opt/

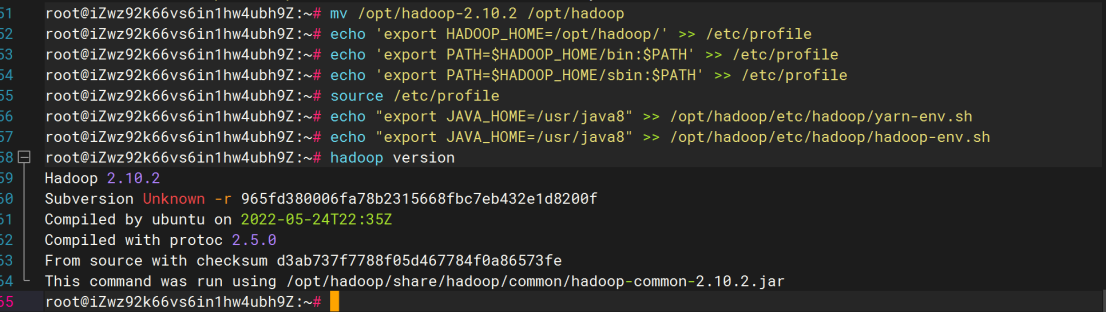

mv /opt/hadoop-2.10.2 /opt/hadoop

配置hadoop

echo 'export HADOOP_HOME=/opt/hadoop/' >> /etc/profile

echo 'export PATH=$HADOOP_HOME/bin:$PATH' >> /etc/profile

echo 'export PATH=$HADOOP_HOME/sbin:$PATH' >> /etc/profile

source /etc/profile

修改配置文件

yarn-env.sh 和 hadoop-env.sh。

echo"exportJAVA_HOME=/usr/java8" >> /opt/hadoop/etc/hadoop/yarn-env.sh

echo"exportJAVA_HOME=/usr/java8">>/opt/hadoop/etc/hadoop/hadoop-env.sh

测试hadoop是否安装成功

hadoop version

修改Hadoop配置文件core-site.xml。

vim /opt/hadoop/etc/hadoop/core-site.xml

在<configuration></configuration>节点内插入如下内容。

<property>

<name>hadoop.tmp.dir</name>

<value>file:/opt/hadoop/tmp</value>

<description>location to store temporary files</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

修改Hadoop配置文件 hdfs-site.xml。

vim /opt/hadoop/etc/hadoop/hdfs-site.xml

在<configuration></configuration>节点内插入如下内容。

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/opt/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/opt/hadoop/tmp/dfs/data</value>

</property>

配置SSH免密登录

(1) 创建公钥和私钥。

ssh-keygen -t rsa

(2) 将公钥添加到authorized_keys文件中。

cd .ssh

cat id_rsa.pub >> authorized_keys

5. 启动Hadoop

初始化namenode 。

hadoop namenode -format

启动Hadoop。

start-dfs.sh

start-yarn.sh

启动成功后,执行以下命令,查看已成功启动的进程

打开浏览器访问http://<公网IP>:8088 和 http://<公网IP>:50070,显示如下界面则表示Hadoop分布式环境搭建完成。